ChatGPT 吃食人者

ChatGPT 的炒作開始減弱,谷歌對“ChatGPT”的搜索量比 4 月份的峰值下降了 40%,而 OpenAI 的 ChatGPT 網站的網絡流量在過去一個月下降了近 10%。

這只是意料之中的事——然而 GPT-4 用戶也報告說,該模型看起來比以前要笨得多(但速度更快)。

一種理論認為,OpenAI 將其分解為多個較小的模型,在特定領域進行訓練,這些模型可以協同工作,但級別不完全相同。

但還有一個更有趣的可能性 可能 人工智能的同類相食也發揮了作用。

現在網絡上充斥著 人工智能生成 文本和圖像,這些合成數據被收集起來作為訓練人工智能的數據,從而導致負反饋循環。 模型攝入的人工智能數據越多,輸出的一致性和質量就越差。 這有點像當你複印一份複印件時所發生的情況,圖像會逐漸變得更糟。

雖然 GPT-4 的官方訓練數據於 2021 年 9 月結束,但它顯然知道的遠不止於此,而 OpenAI 最近關閉了其 網頁瀏覽 插入。

萊斯大學和斯坦福大學科學家的一篇新論文為這個問題提出了一個可愛的縮寫: 自噬紊亂模型 或瘋狂。

他們說:“我們在所有情況下的主要結論是,如果在自噬循環的每一代中沒有足夠的新鮮真實數據,未來的生成模型注定其質量(精度)或多樣性(召回)逐漸下降。”

本質上,模型開始丟失更獨特但代表性較差的數據,並在持續的過程中強化其對變化較少的數據的輸出。 好消息是,這意味著如果我們能夠找到一種方法來識別模型的人類內容並對其進行優先級排序,那麼人工智能現在就有理由讓人類參與其中。 這是 OpenAI 老闆 Sam Altman 的眼球掃描區塊鏈項目 Worldcoin 的計劃之一。

Threads 只是訓練 AI 模型的虧本產品嗎?

Twitter 克隆 Threads 是馬克·扎克伯格的一個有點奇怪的舉動,因為它蠶食了 Instagram 的用戶。 這個照片共享平台每年的收入高達 500 億美元,但從 Threads 獲得的收入約為十分之一,即使它從 Twitter 手中奪走 100% 的市場份額也是不切實際的。 Big Brain Daily 的 Alex Valaitis 預測它將在 12 個月內被關閉或重新併入 Instagram,並認為它現在推出的真正原因“是為了擁有更多基於文本的內容來訓練 Meta 的人工智能模型。”

ChatGPT 接受了來自 Twitter 的大量數據的訓練,但埃隆·馬斯克採取了各種不受歡迎的措施來防止未來發生這種情況(API 訪問收費、速率限制等)。

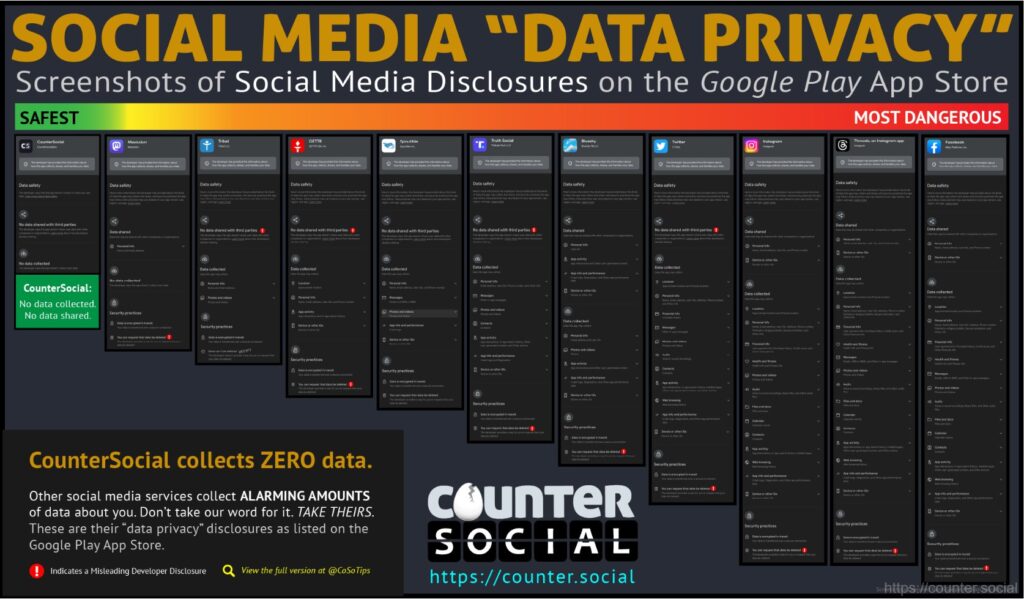

Zuck在這方面已經有形式了,像Meta的圖像識別 人工智能軟件 SEER 接受了培訓 十億 照片發佈到 Instagram。 用戶同意隱私政策中的這一點,並且不少人已經同意 著名的 Threads 應用程序收集一切可能的數據,從健康數據到宗教信仰和種族。 這些數據將不可避免地用於訓練人工智能模型,例如 Facebook 的 LLaMA(大型語言模型元人工智能)。

與此同時,馬斯克剛剛推出了 OpenAI 的競爭對手,名為 人工智能 它將挖掘 Twitter 的數據作為自己的法學碩士。

宗教聊天機器人是原教旨主義者

誰會想到用宗教文本訓練人工智能並用上帝的聲音說話會是一個糟糕的主意? 在印度,偽裝成克里希納的印度教聊天機器人一直在建議用戶,如果這是你的佛法或職責,殺人是可以的。

過去幾個月,至少出現了五個接受過《薄伽梵歌》(Bhagavad Gita)(一部包含 700 節經文的經文)訓練的聊天機器人,但儘管存在道德問題,印度政府仍沒有計劃監管這項技術。

“這是基於宗教文本的錯誤溝通和錯誤信息,” 說 孟買律師 Lubna Yusuf,《人工智能書》的合著者。 “文本賦予了他們想要表達的很多哲學價值,而機器人會做什麼? 它給你一個字面上的答案,這就是危險所在。”

AI 悲觀主義者與 AI 樂觀主義者

世界上最重要的人工智能毀滅者、決策理論家 Eliezer Yudkowsky 在 TED 演講中警告稱,超級智能人工智能將殺死我們所有人。 他不確定如何或為什麼,因為他相信通用人工智能將比我們聰明得多,我們甚至不明白它如何以及為何殺死我們——就像中世紀的農民試圖了解空調的操作一樣。 它可能會殺死我們,因為它是追求其他目標的副作用,或者因為“它不希望我們製造其他超級智能來與之競爭。”

他指出,“沒有人理解現代人工智能係統是如何做它們所做的事情的。 它們是巨大的、難以理解的浮點數矩陣。” 他並不期望“行進中的機器人軍隊會發出紅光”,但他相信“一個更聰明、更冷漠的實體將找出能夠快速可靠地殺死我們的策略和技術,然後殺死我們。” 唯一可以阻止這種情況發生的事情是在第三次世界大戰的威脅下在全球範圍內暫停該技術,但他認為這種情況不會發生。

在他的 散文 “為什麼人工智能會拯救世界,”A16z 的馬克·安德森 (Marc Andreessen) 認為這種立場是不科學的:“可檢驗的假設是什麼? 什麼會證偽這個假設? 我們如何知道何時進入危險區域? 除了“你無法證明它不會發生!”之外,這些問題基本上都沒有得到解答。

微軟老闆比爾·蓋茨發布了 散文 他自己的題為“人工智能的風險是真實的,但可以控制的”,他認為從汽車到互聯網,“人們已經度過了其他變革時刻,儘管經歷了很多動盪,但最終會變得更好。”

“這是我們任何人一生中都會看到的最具變革性的創新,健康的公共辯論將取決於每個人都了解這項技術、其好處和風險。 好處將是巨大的,相信我們能夠管理風險的最佳理由是我們以前已經做到了。”

數據科學家傑里米·霍華德發布了他自己的 紙認為任何禁止該技術或將其限制在少數大型人工智能模型中的嘗試都將是一場災難,並將對人工智能的基於恐懼的反應與啟蒙運動之前的時代進行比較,當時人類試圖將教育和權力限制在精英手中。

“然後一個新的想法出現了。 如果我們相信整個社會的整體利益怎麼辦? 如果每個人都有機會接受教育怎麼辦? 去投票? 科技? 這是啟蒙時代。”

他的反建議是鼓勵人工智能的開源開發,並相信大多數人會利用這項技術來做好事。

“大多數人會使用這些模型來創造和保護。 為了安全,還有什麼比讓整個人類社會的巨大多樣性和專業知識在人工智能的全力支持下盡最大努力識別和應對威脅更好呢?”

OpenAI 的代碼解釋器

GPT-4 的新代碼解釋器是一次了不起的新升級,它允許 AI 按需生成代碼並實際運行它。 因此,任何您能想到的東西,它都可以生成代碼並運行。 用戶已經提出了各種用例,包括上傳公司報告、讓人工智能生成有用的關鍵數據圖表、將文件從一種格式轉換為另一種格式、創建視頻效果以及將靜態圖像轉換為視頻。 一名用戶上傳了美國每個燈塔位置的 Excel 文件,並使用 GPT-4 創建了位置的動畫地圖。

所有殺手級人工智能新聞

— 蒙大拿大學的研究發現,人工智能得分 前 1% 創造力的標準化測試。 Scholastic 測試服務中心在創造力、流暢性(產生大量想法的能力)和原創性方面給 GPT-4 的測試給出了最高分。

— 喜劇演員莎拉·西爾弗曼 (Sarah Silverman) 以及作家克里斯托弗·戈爾登 (Christopher Golden) 和理查德·卡德雷 (Richard Kadreyare) 起訴 OpenAI 和 Meta 侵犯版權,在三人的書籍上訓練各自的人工智能模型。

— 微軟 Windows 版 AI Copilot 最終會令人驚嘆,但 Windows Central 發現內部預覽實際上只是通過 Edge 瀏覽器運行的 Bing Chat,它幾乎可以切換藍牙 在。

— 人擇ChatGPT 的競爭對手 Claude 2 現已在英國和美國免費提供,其上下文窗口可以處理 75,000 字的內容,而 ChatGPT 的最大容量為 3,000 字。 這使得它非常適合總結長文本,而且它是 不錯 在寫小說時。

本週視頻

印度衛星新聞頻道 OTV News 推出了名為 Lisa 的人工智能新聞主播,她將每天以多種語言(包括英語和奧迪亞語)為該網絡及其數字平台多次播報新聞。 OTV 董事總經理 Jagi Mangat Panda 表示:“新的人工智能主播是根據人類主持人的鏡頭創建的數字合成物,該主持人使用合成聲音閱讀新聞。”

訂閱

區塊鏈中最引人入勝的讀物。 每週交付一次。