出乎意料的是,澳大利亞政府宣布了一項為期八週的新磋商,以確定其對人工智能行業的監管力度。

澳大利亞政府啟動了為期八週的快速諮詢,以確定是否應取締任何“高風險”人工智能工具。

最近幾個月,包括美國、歐盟和中國在內的其他地區也採取了措施,以確定並可能減少與人工智能快速發展相關的擔憂。

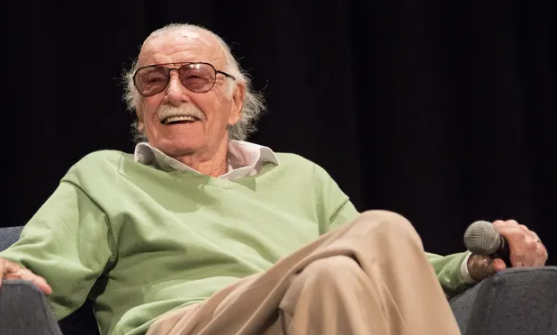

據工業和科學部長 Ed Husic 稱,一份關於“澳大利亞安全和負責任的人工智能”的討論文件和國家科學技術委員會關於生成人工智能的報告均於 6 月 1 日發布。

這些文件是持續到 7 月 26 日的磋商的一部分。

政府正在就如何協助“安全和負責任地使用人工智能”徵求意見,並就是否採用道德框架等自願策略、實施具體監管或將兩者結合進行辯論。

“是否應該完全禁止任何高風險的人工智能應用或技術?” 是諮詢中提出的問題。 以及應該應用什麼標準來確定哪些人工智能工具應該被禁止。

詳盡的討論文件還提供了 AI 模型的草圖風險矩陣以供評論。 它將用於生成醫療病歷等任務的生成人工智能工具歸類為“中等風險”,而將自動駕駛汽車中的人工智能歸類為“高風險”只是為了舉例。

該研究強調了 AI 的“有害”用途,例如 deepfake 工具、用於製作假新聞,以及 AI 機器人鼓勵自我傷害的實例,以及它在醫學、工程和科學領域的“積極”用途。法律行業。

人工智能模型中的偏見和“幻覺”——人工智能產生的錯誤或不可理解的信息——也被認為是問題。

根據討論文件,由於“公眾信任度低”,人工智能在美國的採用率“相對較低”。 此外,它還提到了其他國家的人工智能法律以及意大利對 ChatGPT 的臨時禁令。

澳大利亞在機器人技術和計算機視覺方面擁有一些有利的 AI 能力,但其“核心基礎能力在 [large language models] 相關領域相對薄弱,”國家科學技術委員會的一份報告稱。 它還指出:

“由於生成人工智能資源集中在少數以美國為基地的大型跨國科技公司,澳大利亞面臨潛在風險。”

該論文繼續探索國際人工智能政策,提供了生成人工智能模型的示例,並預測這些技術“可能會影響從銀行和金融到公共服務、教育以及介於兩者之間的一切。”

帖子 在一次意外的磋商中,澳大利亞詢問是否應該取締“高風險”人工智能。 首次出現在 比特幣電線.